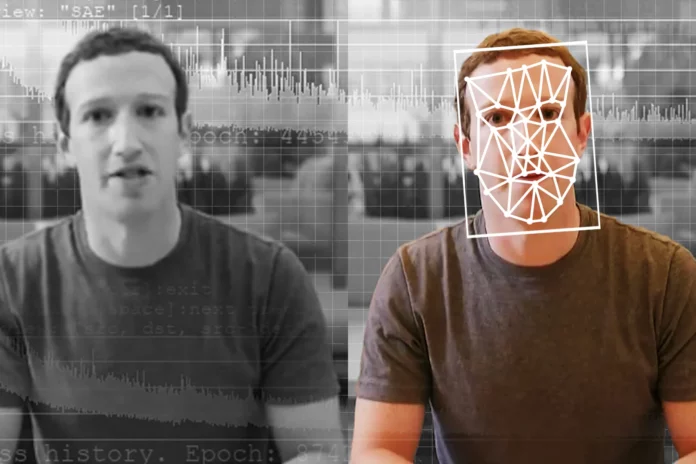

2025 yılı boyunca deepfake teknolojisi önemli ölçüde gelişti. Gerçek insanları taklit eden yapay zeka tarafından üretilen yüzler, sesler ve tam vücut performansları, birkaç yıl önce birçok uzmanın bile beklediğinden çok daha yüksek bir kaliteye ulaştı. Ayrıca, insanları aldatmak için de giderek daha fazla kullanılıyorlar.

Birçok günlük senaryo için -özellikle düşük çözünürlüklü video görüşmeleri ve sosyal medya platformlarında paylaşılan medya için- gerçekçilikleri artık uzman olmayan izleyicileri güvenilir bir şekilde kandıracak kadar yüksek. Pratik anlamda, sentetik medya, sıradan insanlar ve bazı durumlarda kurumlar için bile gerçek kayıtlardan ayırt edilemez hale geldi.

Deepfake teknolojisi için gelecek tahminleri

Bu artış sadece kaliteyle sınırlı değil. Deepfake sayısı da patlayıcı bir şekilde arttı: Siber güvenlik firması DeepStrike, 2023’te yaklaşık 500.000 olan çevrimiçi deepfake sayısının 2025’te yaklaşık 8 milyona çıkacağını ve yıllık büyümenin %900’e yaklaşacağını tahmin ediyor. Ben deepfake ve diğer sentetik medya üzerine araştırma yapan bir bilgisayar bilimcisiyim. Benim bakış açımdan, deepfake’lerin gerçek zamanlı olarak insanlara tepki verebilen sentetik performans sanatçılarına dönüşmesiyle durumun 2026’da daha da kötüleşmesi muhtemel görünüyor.

Bu dramatik artışın altında yatan birkaç teknik değişim var. Birincisi, video gerçekçiliği, özellikle zamansal tutarlılığı korumak için tasarlanmış video üretim modelleri sayesinde önemli bir sıçrama yaptı. Bu modeller, tutarlı hareket, canlandırılan kişilerin tutarlı kimlikleri ve bir kareden diğerine anlamlı içerik içeren videolar üretiyor. Modeller, bir kişinin kimliğini temsil etmeyle ilgili bilgileri hareketle ilgili bilgilerden ayırarak, aynı hareketin farklı kimliklere eşlenebilmesini veya aynı kimliğin birden fazla hareket türüne sahip olmasını sağlıyor. Bu modeller, bir zamanlar deepfake’lerin güvenilir adli kanıtı olarak kullanılan göz ve çene hattı çevresindeki titreme, bozulma veya yapısal deformasyonlar olmadan istikrarlı, tutarlı yüzler üretiyor.

İkincisi, ses klonlama, benim “ayırt edilemezlik eşiği” olarak adlandıracağım noktayı aştı. Artık birkaç saniyelik ses, doğal tonlama, ritim, vurgu, duygu, duraklamalar ve nefes alma sesiyle birlikte ikna edici bir klon oluşturmak için yeterli. Bu yetenek, büyük ölçekli sahtekarlığı zaten körüklüyor. Bazı büyük perakendeciler günde 1.000’den fazla yapay zeka tarafından üretilen dolandırıcılık araması aldıklarını bildiriyor. Bir zamanlar sentetik sesleri ele veren algısal ipuçları büyük ölçüde ortadan kalktı.

Üçüncüsü, tüketici araçları teknik engeli neredeyse sıfıra indirdi. OpenAI’nin Sora 2’si ve Google’ın Veo 3’ünden gelen yükseltmeler ve bir dizi girişim, herkesin bir fikri tanımlayabileceği, OpenAI’nin ChatGPT’si veya Google’ın Gemini’si gibi büyük bir dil modelinin bir senaryo taslağı hazırlamasına izin verebileceği ve dakikalar içinde cilalanmış görsel-işitsel medya üretebileceği anlamına geliyor. Yapay zeka ajanları tüm süreci otomatikleştirebilir. Büyük ölçekte tutarlı, hikaye odaklı deepfake’ler üretme kapasitesi etkili bir şekilde demokratikleştirildi.