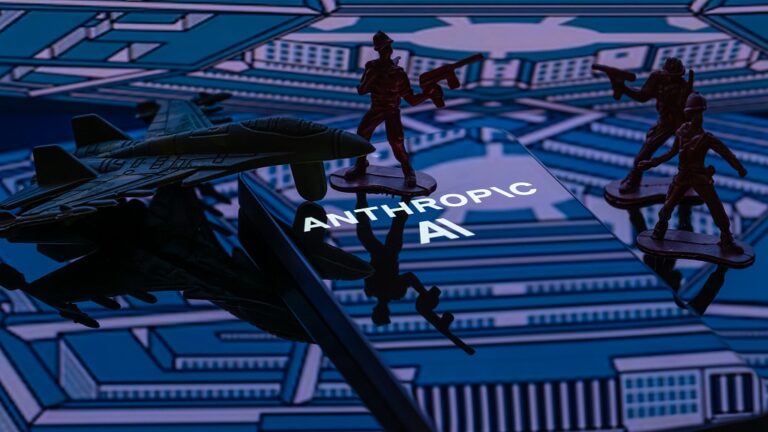

Washington, D.C.’deki bir federal temyiz mahkemesi, yapay zeka şirketi Anthropic’in Pentagon tarafından ulusal güvenlik kara listesine alınmasını engellemeyi reddetti. Bu, Trump yönetimi için bir zafer anlamına geliyor ve Anthropic’in ayrı bir hukuki itirazında başka bir temyiz mahkemesinin tam tersi sonuca varmasının ardından geldi.

Popüler Claude yapay zeka asistanının geliştiricisi Anthropic, Savunma Bakanı Pete Hegseth’in, ürünlerindeki belirli kullanım kısıtlamalarını kaldırmayı reddetmesi nedeniyle şirketi ulusal güvenlik tedarik zinciri riski olarak nitelendirerek yetkisini aştığını iddia ediyor. Bu etiket, Anthropic’in Pentagon sözleşmelerinden men edilmesine ve hükümet genelinde kara listeye alınmasına yol açabilir.

Anthropic kara listede

Anthropic yöneticileri, bu nitelendirmenin şirkete milyarlarca dolarlık iş kaybına ve itibar zedelenmesine mal olabileceğini söyledi. ABD Columbia Bölgesi Temyiz Mahkemesi’nin bir heyeti, dava sonuçlanana kadar nitelendirmenin durdurulması yönündeki Anthropic’in talebini reddetti. Karar nihai bir karar değil.

Kararın ardından yapılan açıklamada, Anthropic sözcüsü, şirketin mahkemenin nihayetinde tedarik zinciri risk sınıflandırmasının yasa dışı olduğuna karar vereceğinden emin olduğunu söyledi. Başsavcı Vekili Todd Blanche, Çarşamba günü sosyal medyada yaptığı bir paylaşımda kararı askeri hazırlık için bir zafer olarak nitelendirdi.

Blanche, Trump’ın Savunma Bakanlığı için kullandığı yeni ismi kullanarak, “Askeri yetki ve operasyonel kontrol, bir teknoloji şirketine değil, Başkomutan ve Savaş Bakanlığı’na aittir” dedi. Dava, Anthropic’in Hegseth’in emsalsiz hamlesi üzerine açtığı iki davadan biri. Bu hamle, Anthropic’in güvenlik ve etik kaygıları nedeniyle ABD gözetimi veya otonom silahlar için yapay zeka sohbet robotu Claude’un kullanılmasına izin vermeyi reddetmesinin ardından geldi.

Hegseth, Anthropic’i iki farklı yasa kapsamında suç kapsamına alan emirler verdi ve Anthropic bunların her birine ayrı ayrı itiraz ediyor. Kaliforniya’daki bir federal yargıç, 26 Mart’ta emirlerden birini bloke ederek, Pentagon’un Anthropic’e yapay zeka güvenliği hakkındaki görüşleri nedeniyle yasa dışı bir şekilde misilleme yapmış gibi göründüğünü söyledi.

Anthropic’in bu şekilde nitelendirilmesi, ABD’li bir şirketin, askeri sistemleri düşman sabotajından veya sızmasından korumayı amaçlayan belirsiz hükümet tedarik yasaları kapsamında tedarik zinciri riski olarak kamuoyuna açık bir şekilde nitelendirildiği ilk örnekti.