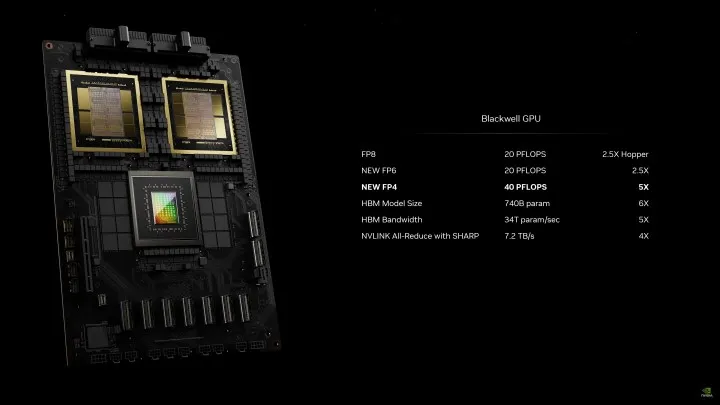

Nvidia, trilyon dolarlık şirket haline getiren Hopper H100 GPU’lara kıyasla 5 kata kadar performans artışı sunan yeni nesil Blackwell GPU mimarisini ve Blackwell B200 GPU’yu tanıttı. Rakipleriyle rekabet ederken, Nvidia yeni Blackwell B200 GPU ve GB200 Superchip ürünlerini resmen duyurdu. İşte tüm detaylar:

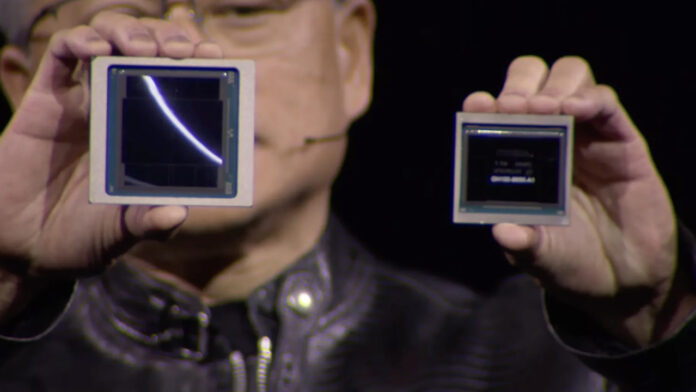

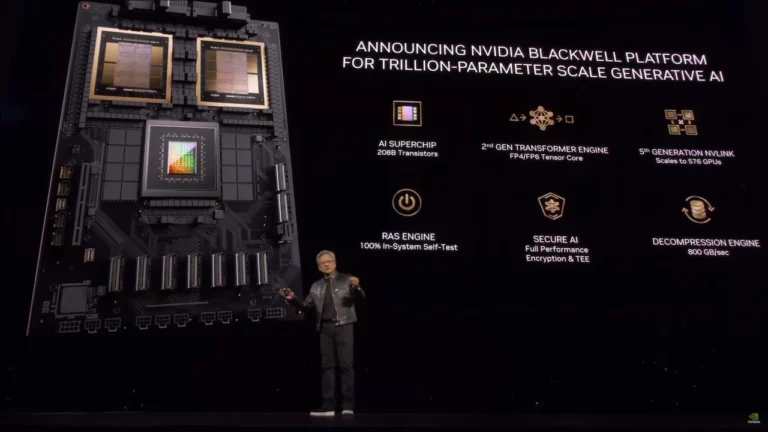

Nvidia Blackwell Mimarisi ve Yeni Blackwell B200 Nvidia, Blackwell kod adlı yeni nesil AI & Tensor Core GPU mimarisini detaylandırdı. Blackwell GPU’ları, Nvidia’nın aynı kalıp üzerinde iki GPU’yu bir araya getirdiği ilk MCM tasarımı olacak. Blackwell mimarisi TSMC 4NP işlem sürecinde üretilen her bir hesaplama kalıbında toplam 104 Milyar transistör içeriyor. Blackwell B200 GPU’lar, toplamda 208 milyar transistöre erişerek 8 TB/s bellek bant genişliği ve 192 GB’a kadar 8 katmanlı HBM3e belleklerle donatılmış.

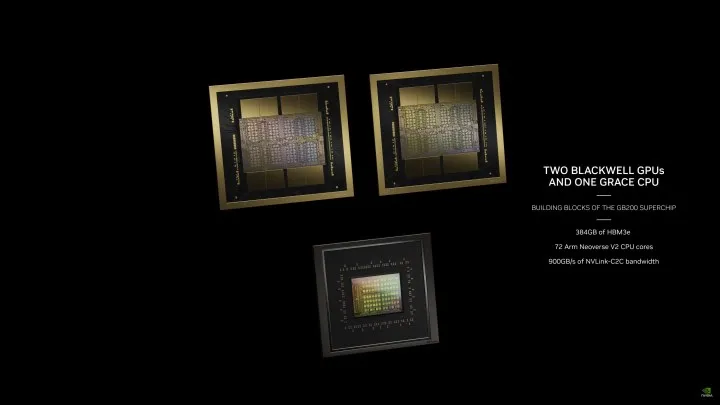

Entegre Donanımlı Platform Nvidia, Blackwell GPU’ları tam donanımlı bir platform olarak sunuyor ve dört işlem kalıbı olan bu GPU’lardan ikisini tek bir Grace CPU (72 ARM Neoverse V2 CPU çekirdeği) ile birleştiriyor. GPU’lar hem birbirleriyle hem de Grace CPU ile 900GB/s NVLink arabağlantı protokolüyle bağlanıyor.

Yüksek Performans ve Verimlilik Nvidia, GB200’ün LLM çıkarım iş yükleri için 30 kat daha fazla performans sunduğunu belirtiyor. H100’e göre maliyeti ve enerji tüketimini 25 kata kadar azaltıyor. Yapılan iyileştirmelerle 1,8 trilyon parametreli bir yapay zeka modelinin eğitilmesi için gereken güç ve kaynaklar büyük ölçüde azalıyor.

Yüksek Ölçeklenebilirlik Nvidia, yeni 5. nesil NVLink ile 576 GPU’nun saniyede 1,8 terabayt çift yönlü bant genişliğiyle birbiriyle konuşmasını sağlıyor. Bu, büyük ölçekli yapay zeka iş yüklerini desteklemek için önemli bir gelişmedir.

Sunulan Çözümler Nvidia, GB200 NVL72 paketi ile toplam 720 petaflop AI eğitim performansı veya 1.440 petaflop çıkarım sunuyor. Ayrıca DGX Superpod for DGX GB200 çözümü ile toplam 11,5 exaflop FP4 hesaplama sağlanacak. HGX B200 platformu ise HPC’lere yönelik olarak sunuluyor.

Nvidia, yapay zeka ve veri merkezi endüstrisindeki liderliğini koruyarak, Blackwell B200 gibi yenilikçi çözümlerle sektördeki standartları belirlemeye devam ediyor.